3月27日凌晨,阿里巴巴发布并开源首个端到端全模态大模型通义千问Qwen2.5-Omni-7B,可同时处理文本、图像、音频和视频等多种输入,并实时生成文本与自然语音合成输出。在权威的多模态融合任务OmniBench等测评中,Qwen2.5-Omni刷新业界纪录,全维度远超Google的Gemini-1.5-Pro等同类模型。

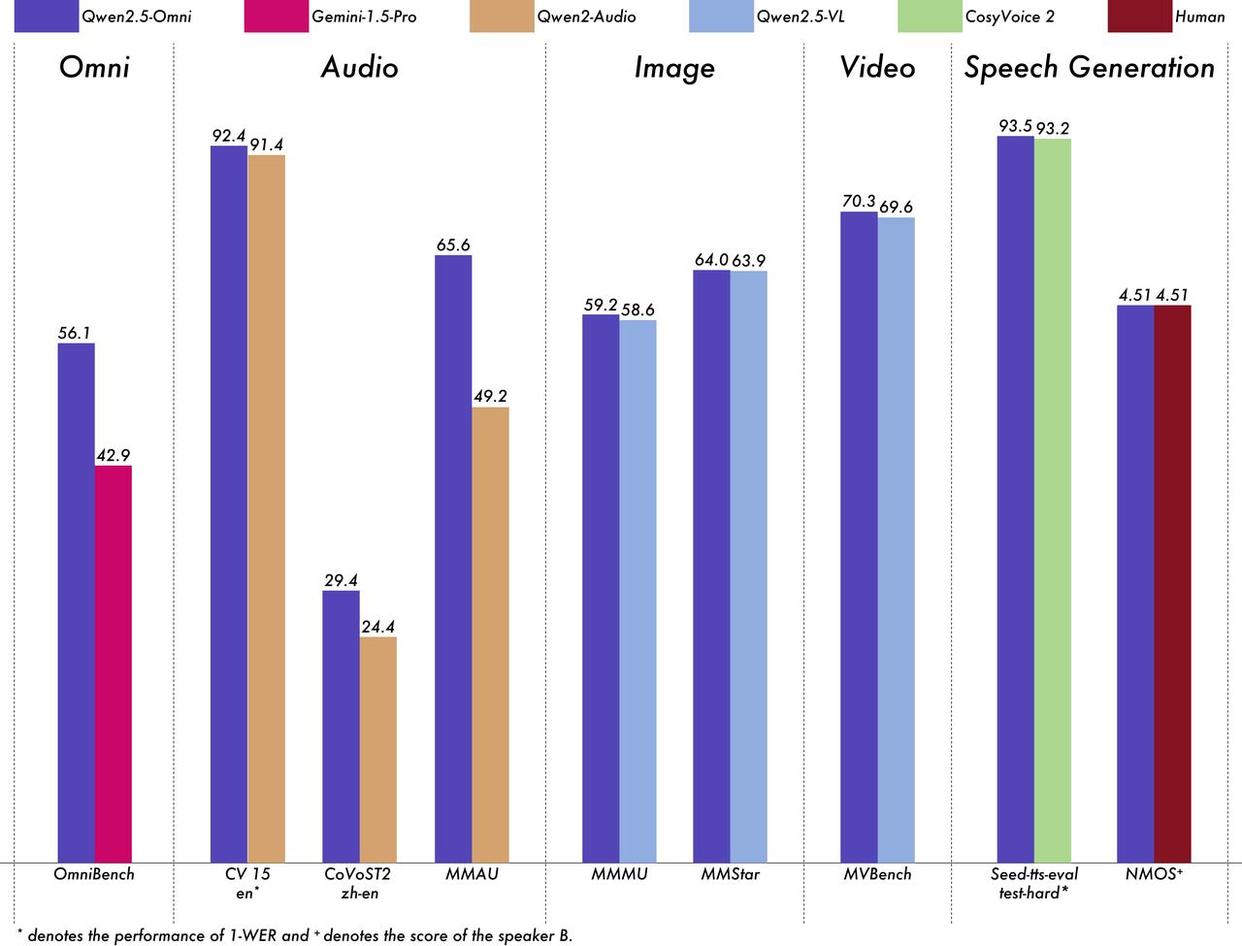

性能测评对比,图源:网络

据了解,Qwen2.5-Omni以接近人类的多感官方式“立体”认知世界并与之实时交互,还能通过音视频识别情绪,在复杂任务中进行更智能、更自然的反馈与决策。现在,开发者和企业可免费下载商用Qwen2.5-Omni,手机等终端智能硬件也可轻松部署运行。

Qwen2.5-Omni采用了通义团队全新首创的Thinker-Talker双核架构、Position Embedding (位置嵌入)融合音视频技术、位置编码算法TMRoPE(Time-aligned Multimodal RoPE)。双核架构Thinker-Talker让Qwen2.5-Omni拥有了人类的“大脑”和“发声器”,形成了端到端的统一模型架构,实现了实时语义理解与语音生成的高效协同。具体而言,Qwen2.5-Omni支持文本、图像、音频和视频等多种输入形式,可同时感知所有模态输入,并以流式处理方式实时生成文本与自然语音响应。

得益于上述突破性创新技术,Qwen2.5-Omni在一系列同等规模的单模态模型权威基准测试中,展现出了全球最强的全模态优异性能,其在语音理解、图片理解、视频理解、语音生成等领域的测评分数,均领先于专门的Audio或VL模型,且语音生成测评分数(4.51)达到了与人类持平的能力。(新闻来源:钱江晚报)

商务合作:13146398132

媒体合作:13341147250

爆料投稿:editor@vrarworld.cn

版权声明:本文为VRAR星球原创,任何单位及个人未经授权不得转载,否则将依法追究侵权责任。

如需转载请联系13341147250 / editor@vrarworld.cn 申请授权,转载时请注明来源并保留VRAR星球原文链接。

本文部分图片及视频来源于互联网,如涉及侵权请联系我们删除。

苹果公布2026年设计大奖,五款Vision Pro原生应用入围

Pimax Dream Air SE PC VR头显开始发货,但订单可能需要数周才能送达

Meta本周开始大规模裁员,预计削减约8000个岗位

苹果公布2026年设计大奖,五款Vision Pro原生应用入围

Pimax Dream Air SE PC VR头显开始发货,但订单可能需要数周才能送达

Meta本周开始大规模裁员,预计削减约8000个岗位

《卧底特工》将于7月登陆Steam,支持VR和PC版

VR音游Synth Riders推出新曲目《节奏地牢》

MR恐龙建造体验游戏Le Dino Labo最新DLC《白垩纪掠食者与猎物》现已推出

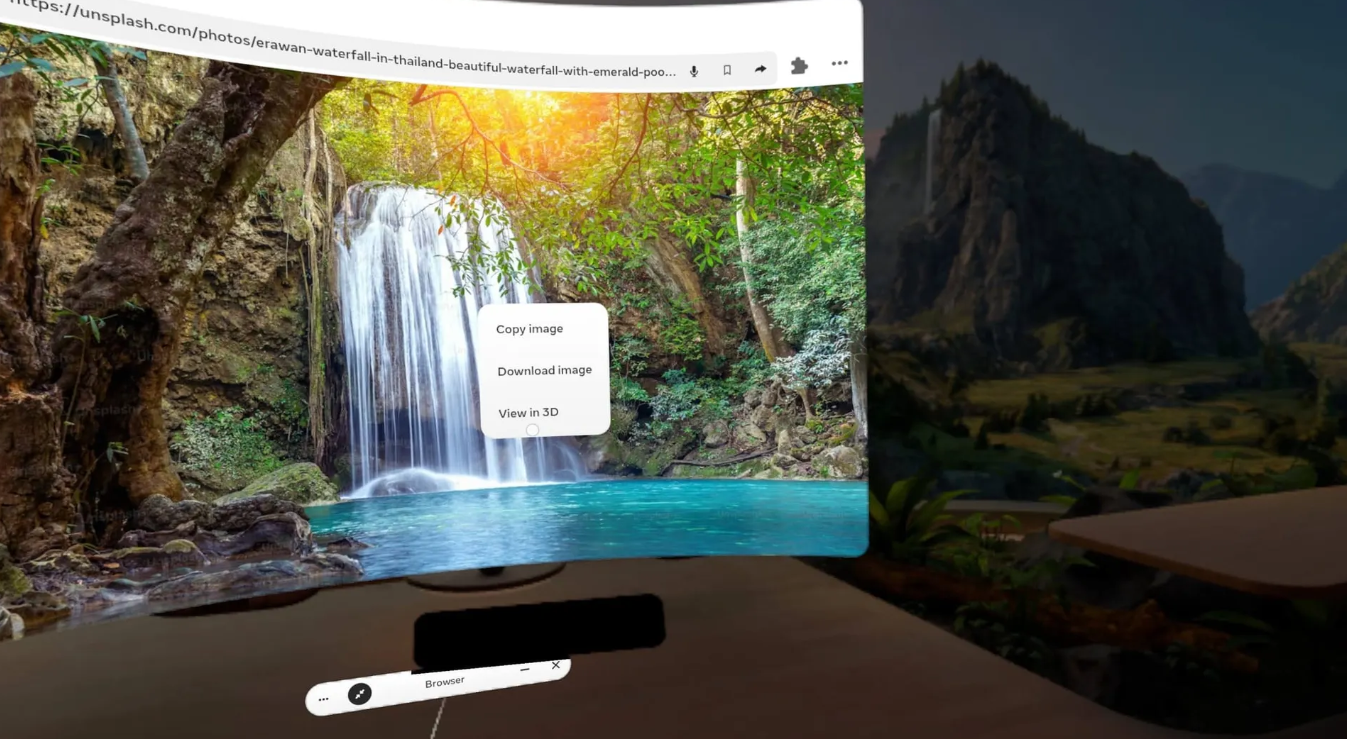

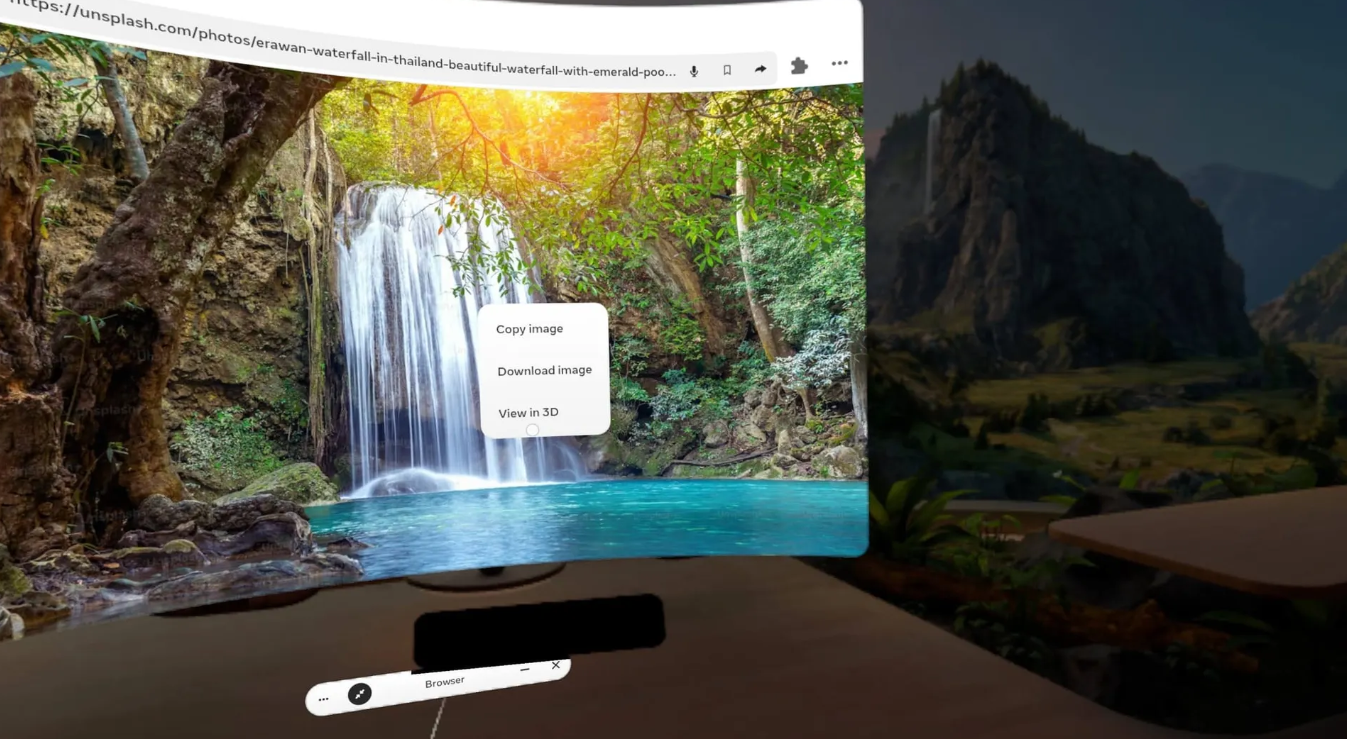

Quest最新PTC更新可将网页照片转换为3D图片

Meta和依视路陆逊梯卡在阿联酋推出两款全新的Ray-Ban Meta光学款AI眼镜

ROG XREAL R1正式开启预约,首发价5999元

苹果公布2026年设计大奖,五款Vision Pro原生应用入围

Pimax Dream Air SE PC VR头显开始发货,但订单可能需要数周才能送达

Meta本周开始大规模裁员,预计削减约8000个岗位

《卧底特工》将于7月登陆Steam,支持VR和PC版

VR音游Synth Riders推出新曲目《节奏地牢》

MR恐龙建造体验游戏Le Dino Labo最新DLC《白垩纪掠食者与猎物》现已推出

Quest最新PTC更新可将网页照片转换为3D图片

Meta和依视路陆逊梯卡在阿联酋推出两款全新的Ray-Ban Meta光学款AI眼镜

ROG XREAL R1正式开启预约,首发价5999元